Herrschaft, die keinen Widerspruch duldet, hat ein bekanntes Problem, das mit dem technologischen Wandel neu aufgelegt wird: Wer keine Kritik hören will, erfährt meist auch nicht mehr, was im Land vorgeht. Bereits an den Höfen des europäischen Adels kannte man diese Kommunikationspathologie. Machiavelli warnte in seinem Buch „Il Principe“, die Höfe seien voller Schmeichler. Ein kluger Herrscher müsse sicherstellen, dass er vor lauter Zustimmung nicht den Kontakt zur Wirklichkeit verliert. Um den Respekt vor der Herrschaft nicht grundsätzlich infrage zu stellen, wollte Machiavelli das Privileg der schonungslosen Wahrheit den „klugen Leuten“ vorbehalten.

In einer modernen Demokratie gilt diese Einschränkung nicht mehr. In seiner Analyse der „Grundrechte als Institution“ beschrieb Niklas Luhmann die Kommunikationsfreiheiten des Einzelnen und der Presse als Barrieren gegen eine Vereinnahmung der Gesellschaft durch die Politik. Nur eine politisch unkontrollierte öffentliche Meinung kann Probleme thematisieren und auf Entscheidungsbedarf hinweisen. Die Meinungs- und Pressefreiheit schützt damit nicht Individuen, sondern die Fähigkeit der Politik, sich an gesellschaftlichen Erwartungen zu orientieren. Wird die Öffentlichkeit unterdrückt, verliert die Politik ihre Sensibilität für gesellschaftliche Probleme und orientiert sich an ihren eigenen Projektionen.

Wird zensiert, fehlt das Zensierbare in den Trainingsdaten

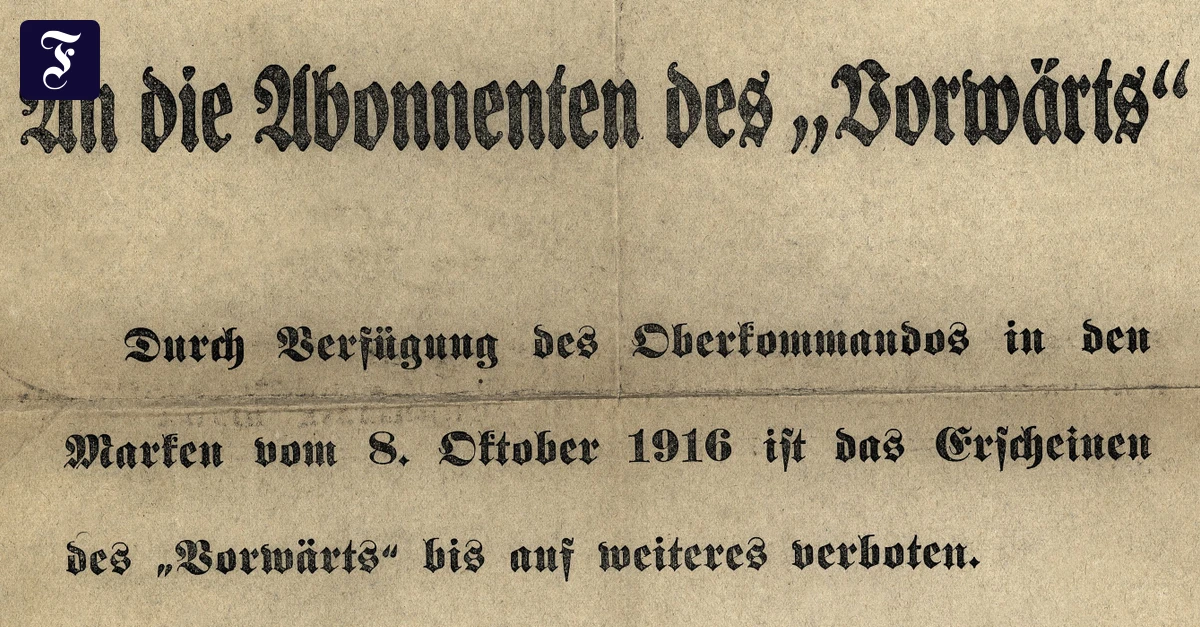

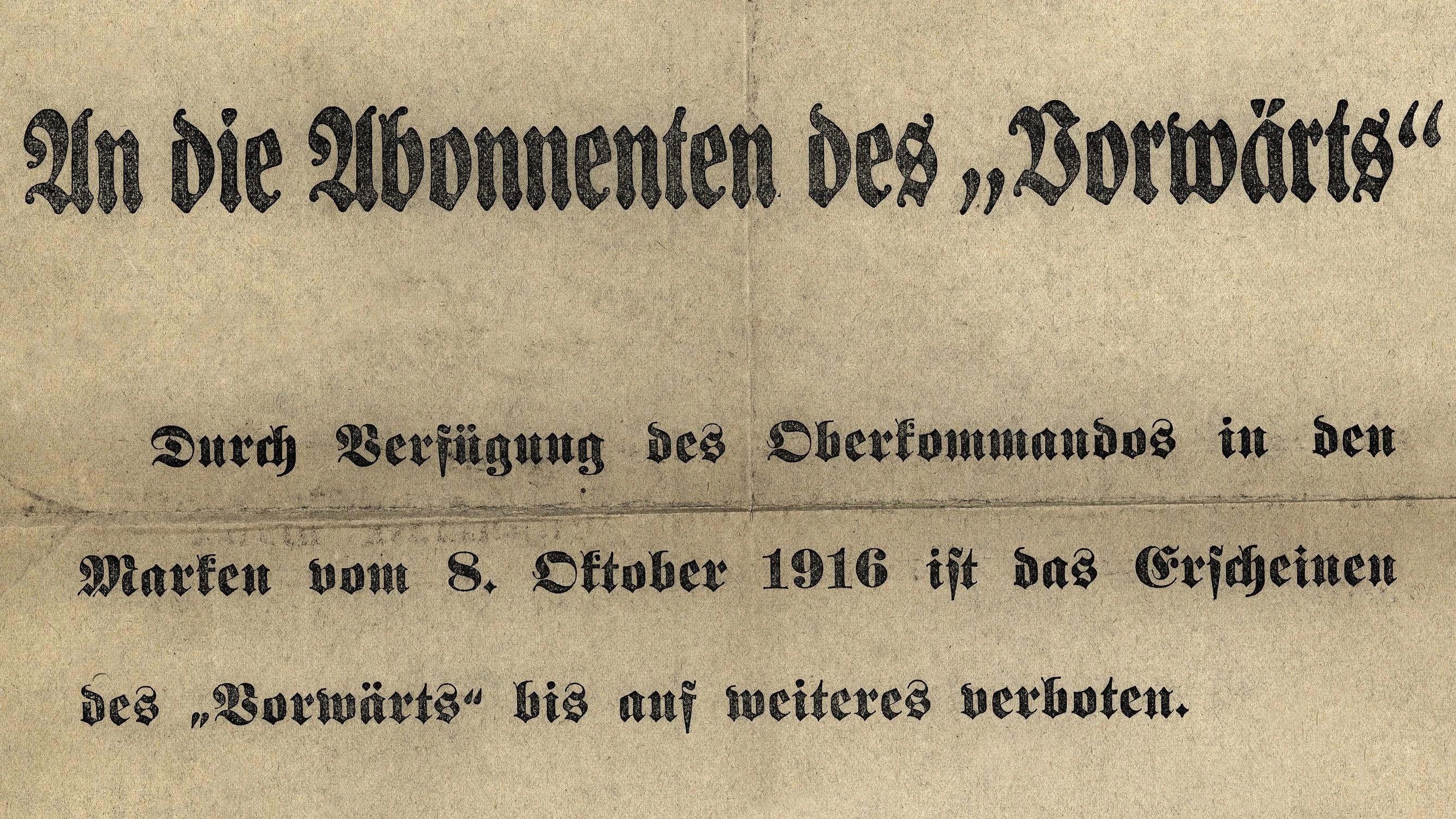

Autoritäre Politik, die ein bisschen Öffentlichkeit zulassen, ansonsten aber unbehelligt bleiben möchte, greift zur Zensur. Doch die ist zeit- und personalintensiv, weshalb technologische Hilfe willkommen ist. Eine kürzlich veröffentlichte Studie zeigt jedoch, dass Technologie – hier der Einsatz Künstlicher Intelligenz zu Zensurzwecken in China – die Kontrollfähigkeit unter bestimmten Bedingungen sogar untergräbt. Denn die autoritäre Herrschaft erzeugt ein Datenproblem: Eine Zensur-KI kann nur dann zuverlässig zensieren, wenn sie zuvor genügend Beispiele des Zensierbaren gesehen hat. Je mehr Menschen jedoch aus Angst schweigen, ihre Präferenzen verheimlichen oder auf kryptische Rede ausweichen, desto schlechter wird das Material, an dem die Maschine lernen soll, was überhaupt als gefährlich gilt.

Dieser Effekt zeigt sich in einem Experiment, das auf Millionen chinesischer Social-Media-Beiträge auf den Plattformen Weibo und Twitter basiert. Der Politikwissenschaftler Eddie Yang hat hierfür kommerzielle Zensurmodelle rekonstruiert und weist nach, dass die Treffgenauigkeit mit zunehmender Repression sinkt. In politischen Krisen fällt sie besonders deutlich, weil die plötzlich sichtbare Kritik in den Trainingsdaten zuvor systematisch fehlte. Eine KI, die nur an bereinigter Normalität geschult wurde, erkennt im Ernstfall das weiße Blatt eben nicht als mögliches Protestsymbol, sondern nur als Leerstelle. Besonders unerquicklich für den Apparat ist, dass die Fehler häufig in Form einer falschen Entwarnung auftreten – also genau dort, wo die Zensur einerseits eingreifen und andererseits Rückmeldung geben müsste.

Dem Versagen der datenbasierten Zensur ist mit mehr Daten kaum abzuhelfen: Zusätzliche Trainingsdaten aus chinesischen Quellen verbessern die Modelle nur marginal. Ein spürbarer Effekt tritt auf, wenn ausländische Daten hinzugefügt werden, zum Beispiel aus Twitter. Chinesischsprachige Tweets enthalten Mitteilungen, die in Chinas Datenraum bereits weggefiltert oder gar nicht erst geäußert wurden. Der digitale Autoritarismus könnte sich also ausgerechnet bei jener Kritik bedienen, die er zu Hause zum Verstummen gebracht hat. Doch auch dieser Umweg hilft nur begrenzt: Der aus dem Exil oder von internationalen Beobachtern geführte Diskurs unterscheidet sich zu stark von der domestizierten Binnenkommunikation.

Die Studie zeigt, dass eine zensierte Öffentlichkeit nicht nur ihre Funktion als Sensorium gesellschaftlicher Probleme einbüßt, sondern auch nur noch bedingt für Kontrollzwecke instrumentalisiert werden kann. Wer sie nach eigenem Gusto formt, bekommt weniger Widerspruch, aber auch weniger Wirklichkeit. Darunter leidet auch die Fähigkeit, Kritik überhaupt als solche zu erkennen. Die Freiheit der Kommunikation ist kein sentimentaler Luxus, sondern eine epistemische Infrastruktur des Regierens – auch und gerade dann, wenn das Regieren sich gegen die Interessen der Bevölkerung richtet. Wer Kritik unterdrücken möchte, benötigt entweder hermeneutisches Gespür oder gutes Material. In Ermangelung einschlägiger Datenpunkte kann auch die KI wenig ausrichten – und wäre allenfalls noch geeignet, die Kunst der Schmeichelei zu perfektionieren.

N. Luhmann (1965): Grundrechte als Institution. Berlin; E. Yang (2026): The limits of AI for authoritarian control. American Journal of Political Science, Artikel 70045. https://doi.org/10.1111/ajps.70045